19.08.2024 Warsztat reportera

Jak działa ChatGPT, Google Gemini i inne Duże Modele Językowe LLM

Krzysztof Fiedorek

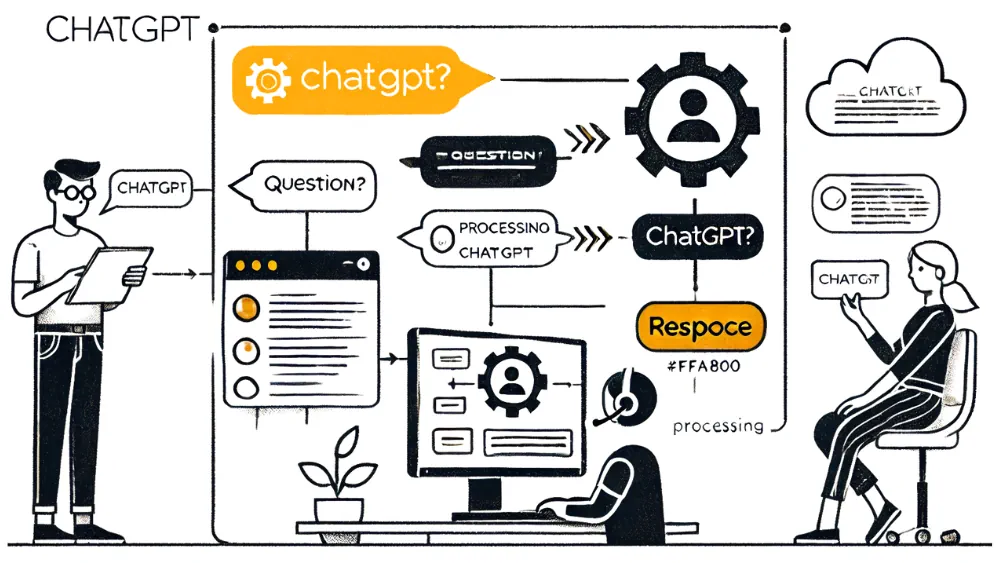

ilustracja: bing.com/create

ilustracja: bing.com/createJednym z najbardziej imponujących osiągnięć AI są duże modele językowe (LLM – Large Language Models), takie jak ChatGPT czy Google Gemini. W ostatnich latach sztuczna inteligencja (AI) zrewolucjonizowała wiele dziedzin naszego życia. Chociaż ich działanie może wydawać się magiczne, w rzeczywistości opiera się na solidnych podstawach matematycznych i informatycznych.

Czym są i jak działają duże modele językowe?

LLM to rodzaj modelu językowego, który został wytrenowany na ogromnych ilościach danych tekstowych. Dzięki temu jest w stanie zrozumieć i generować ludzki język w sposób naturalny. Model ten opiera się na architekturze sieci neuronowych, która naśladuje sposób, w jaki działa ludzki mózg.

- Szkolenie: Proces tworzenia LLM rozpoczyna się od zebrania ogromnej ilości danych tekstowych. Mogą to być artykuły, książki, strony internetowe, a nawet rozmowy na czatach. Następnie model jest trenowany na tych danych, ucząc się rozpoznawać wzorce i zależności między słowami.

- Generowanie tekstu: Kiedy zadajemy LLM pytanie lub podajemy mu jakieś polecenie, model analizuje otrzymany tekst i próbuje zrozumieć jego znaczenie. Następnie generuje odpowiedź, wybierając słowa i frazy, które są najbardziej prawdopodobne w danym kontekście.

- Uczenie się przez wzmacnianie: LLM są stale ulepszane dzięki mechanizmowi uczenia się przez wzmacnianie. Oznacza to, że model otrzymuje informacje zwrotne od ludzi na temat jakości generowanych przez niego tekstów. Dzięki temu może poprawiać swoje umiejętności i generować coraz lepsze odpowiedzi.

Dane treningowe są niczym paliwo dla dużych modeli językowych (LLM). To właśnie na ich podstawie modele uczą się rozpoznawać wzorce, zależności i konteksty, które umożliwiają im generowanie spójnych i sensownych tekstów. Zbiór danych treningowych ChatGPT, Google Gemini i innych LLM jest niezwykle różnorodny i obejmuje praktycznie wszystkie formy tekstu dostępne w sieci: artykuły, książki, strony internetowe, posty na blogach, komentarze, wiadomości, a nawet kod źródłowy. To jakość danych treningowych ma kluczowe znaczenie dla jakości generowanych tekstów.

Architektura dużych modeli językowych

Duże modele językowe LLM to niezwykle skomplikowane systemy, które w dużym uproszczeniu można porównać do bardzo zaawansowanych maszyn do pisania. Jednak w przeciwieństwie do swoich mechanicznych poprzedników, LLM posiadają zdolność do "rozumienia" języka i generowania nowych, spójnych tekstów.

Podstawowym elementem budowy każdego LLM są sieci neuronowe. To matematyczne modele inspirowane strukturą ludzkiego mózgu. Składają się one z wielu połączonych ze sobą neuronów sztucznych, które przetwarzają informacje. W przypadku LLM, neurony te przetwarzają słowa i frazy.

Jak to działa w praktyce? Kiedy podajemy w prompcie ChataGPT czy Google Gemini jakiś tekst, model przekształca go na sekwencję liczb, które reprezentują poszczególne słowa. Następnie dane są przekazywane przez kolejne warstwy sieci neuronowej. W każdej warstwie mechanizm uwagi pozwala modelowi skupić się na różnych częściach wejściowego tekstu, co umożliwia mu zrozumienie kontekstu. Na końcu, model generuje sekwencję liczb, która jest następnie przekształcana z powrotem na tekst.

Ograniczenia generatorów treści AI

Chociaż LLM są niezwykle zaawansowanymi modelami, mają również swoje ograniczenia. Ich zrozumienie jest kluczowe dla odpowiedzialnego wykorzystania tej technologii.

- Brak prawdziwego zrozumienia: LLM nie posiadają prawdziwego zrozumienia świata i często mają problemy z pełnym zrozumieniem kontekstu, zwłaszcza w przypadku bardziej złożonych lub nietypowych zapytań. Generowane teksty opierają się na wzorcach wyuczonych na podstawie danych treningowych.

- Możliwość generowania błędnych informacji: Model może generować teksty, które są nieprawdziwe lub wprowadzające w błąd.

- Brak świadomości: LLM nie posiadają świadomości ani własnych opinii. Generowane przez niego teksty są jedynie odzwierciedleniem danych, na których został wytrenowany.

ChatGPT, Google Gemini i inne generatory treści AI niosą ze sobą ogromny potencjał, ale jednocześnie rodzą wiele pytań natury etycznej. Jednym z największych obaw związanych z rozwojem tego typu systemów jest możliwość ich wykorzystania do generowania dezinformacji, fake newsów i manipulowania opinią publiczną.

Wyzwania i przyszłość LLM

LLM są wciąż rozwijanymi modelami, a ich możliwości będą na pewno rosły w przyszłości. Możemy spodziewać się, że duże modele językowe będą coraz lepiej naśladowały ludzką rozmowę i będą w stanie wykonywać coraz bardziej złożone zadania. Jednakże, ważne jest, aby pamiętać, że LLM jest narzędziem, które powinno być używane z rozwagą. Ich rozwój nie jest pozbawiony wyzwań.

- Zużycie zasobów: Trening i uruchomienie LLM wymagają ogromnych ilości energii obliczeniowej, co generuje wysokie koszty i ma negatywny wpływ na środowisko.

- Stronniczość: LLM są trenowane na ogromnych zbiorach danych, które mogą zawierać ukryte uprzedzenia. To z kolei prowadzi do generowania tekstów, które utrwalają stereotypy i dyskryminację.

- Halucynacje: LLM mogą generować teksty, które brzmią przekonująco, ale są całkowicie nieprawdziwe. To zjawisko nazywane jest halucynacjami i jest jednym z największych problemów związanych z LLM.

- Prywatność: Zbieranie ogromnych ilości danych tekstowych do trenowania LLM rodzi poważne problemy związane z ochroną prywatności.

- Interpretowalność: Działanie LLM jest bardzo trudne do zrozumienia dla człowieka. To utrudnia diagnozowanie błędów i poprawianie modeli.

Badacze na całym świecie pracują nad rozwiązaniem tych problemów. Obecnie badania koncentrują się na poprawie efektywności energetycznej, rozwiązaniu problemu stronniczości, poprawie wiarygodności i unikaniu halucynacji oraz ochronie prywatności.

PRZERWA NA REKLAMĘ

Najnowsze w dziale Warsztat reportera:

Sztuczna inteligencja w produkcji filmowej i telewizyjnej. Raport McKinsey

Krzysztof Fiedorek

Globalne wydatki na treści wideo sięgnęły 180 mld dolarów, a przeciętny widz konsumuje je przez 7,5 godziny dziennie. Streaming rośnie o 13%, tradycyjna telewizja traci 4% rocznie. Aż 84% rynku w USA kontroluje siedmiu największych graczy. Do tego rynek przetasowuje technologia AI.

Reporter na wojnie. Nowe dylematy zawodu dziennikarskiego

Marta Danowska-Kisiel

Dylematy polskich korespondentów wojennych, techniki relacjonowania wydarzeń na froncie i kształtowanie wizerunku zawodowego dziennikarza pracującego w kraju objętym konfliktem opisuje w swoim artykule prof. dr hab. Igor Borkowski, dziekan Wydziału Prawa i Komunikacji Społecznej we Wrocławiu Uniwersytetu SWPS.

Z parkietu prosto na kolokwium. Codzienność, której nie pokazują transmisje meczowe

KSG Warszawa

Jak wygląda życie osoby, która jednego dnia zdaje egzamin na uczelni, a następnego gra o punkty w 1. lidze? Gdy większość studentów po zajęciach spotyka się na kawie, one biegną na halę.

Podobne artykuły:

Dziennikarstwo - zawód i służba [LINK]

ks. Roman Kempny

Wywiad z abp. Johnem Patrickiem Foleyem, przewodniczącym Papieskiej Rady ds. Środków Społecznego Przekazu. Wywiad pochodzi z serwisu www.opoka.org.pl. Był publikowany w "Gościu Niedzielnym".

Psychika kluczem do sukcesu. Jak buduje się przyszłych mistrzów sportu

Sonia Stępień, oLIVE media

Psychologia sportowa odgrywa coraz większą rolę w rozwoju młodych sportowców, co w swojej debiutanckiej książce "Mistrzostwo umysłu" podkreśla Mateusz Brela, psycholog współpracujący z Kaman Sport Group. Maciej Ignatowski, prezes KSG, od lat dostrzega, jak istotne jest wsparcie psychologiczne, uzupełniające trening fizyczny. Eksperci podzielili się swoimi doświadczeniami, pokazując, jak psychologia sportowa przyczynia się do rozwoju młodych talentów.

Warto przeczytać. Instrukcja obsługi tekstów. Metody retoryki

Bartłomiej Dwornik

Chcesz poznać chwyty retoryczne, przydatne w komunikacji? Zestawienie praktycznych porad, wytłumaczonych na obrazowych przykładach przygotowało Gdańskie Wydawnictwo Psychologiczne.

Najpierw pandemia, a teraz wojna. Czy staniemy się silniejsi?

SWPS

Wydawało nam się, że pandemia i wojna w środku Europy w XXI wieku to sceny z filmu katastroficznego. Jednak ostatnie dwa lata pokazały, że mogą stać się rzeczywistością. Jak te wydarzenia na nas wpływają? Jak różni się nasze zachowanie wobec koronawirusa i wojny? Dlaczego w obliczu zagrożenia stajemy się pomocni i solidarni?